Publié: Avril 22, 2024

Les biais dans la machine : biais des données d’entraînement et leur impact sur le code généré par les assistants de programmation IA

1981 fut une année exceptionnelle pour la musique inspirée par l'informatique et le futurisme. On peut citer le titre dystopique « Red Barchetta » extrait de l'album de Rush. Images animées, à l'intégralité de Kraftwerk Computer WorldLes artistes envisageaient l'avenir avec une précision technologique remarquable. Comme le disait Kraftwerk : « Je programme mon ordinateur personnel, je me téléporte dans le futur. » Un autre album de ce genre est… Fantôme dans la machine L'album « The Police » aborde l'influence croissante de la technologie comme thème central. Le groupe porte un regard plus cynique sur les aspects négatifs potentiels du progrès technologique. L'album reste d'actualité, car leur vision d'un monde en pleine mutation demeure pertinente.

Depuis 1981 et la révolution de l'ordinateur personnel, la technologie a évolué à une vitesse fulgurante, aboutissant (jusqu'à présent) à l'essor des assistants de programmation basés sur l'IA. Ces outils promettent de simplifier le processus de codage, mais à l'instar de l'album de The Police mentionné plus haut, qui recèle un sentiment d'aliénation sous-jacent, un facteur caché entre également en jeu.

Biais dans l'IA

Aussi néfastes soient-ils, les biais engendrent la désillusion et s'insinuent dans les données d'entraînement des assistants IA. Le groupe The Police chante dans « Invisible Sun » l'influence positive d'une force invisible ; cependant, l'aspect négatif est tout aussi réel. Les outils d'IA biaisés peuvent avoir des conséquences imprévues et nuire à leur bon fonctionnement. Voyons donc comment ces biais peuvent devenir les « fantômes de la machine » des outils d'IA.

« Trop d’informations me traversent l’esprit »

L'apprentissage automatique alimente les assistants de codage IA et les outils génératifs, révolutionnant ainsi la conception logicielle. Leur fonction principale est de gérer les tâches répétitives et de proposer des modifications de code de manière fluide. Considérés comme des développeurs juniors, ils nécessitent une grande quantité de données pour progresser. Celles-ci se présentent sous la forme d'une vaste collection de projets antérieurs, que l'IA utilise comme un manuel d'instructions. Ces données permettent à l'IA de s'entraîner et, en analysant le code, elle peut en comprendre les schémas et écrire du code plus efficacement.

L'essentiel est que les données soient de haute qualité et variées. Ces informations constituent le fondement du savoir de l'IA et doivent être suffisamment fiables pour garantir des résultats de qualité.

« Ils soumettent les faibles, mais c'est la rhétorique de l'échec. »

Le talon d'Achille des assistants de programmation IA réside dans les biais qu'ils recèlent. Leur fondement repose sur les données d'entraînement des modèles d'IA. De même qu'une fondation déséquilibrée se fissure et engendre une structure instable, il en va de même pour les modèles d'IA. Des données truffées de biais cachés compromettent l'ensemble du modèle. Ces biais peuvent prendre diverses formes :

- Préjugés sociaux – peuvent refléter les préjugés de la société

- Préjugés sexistes – pourrait privilégier un genre plutôt qu'un autre

- biais culturels – pourrait fausser les données en faveur de cultures spécifiques

Les biais qui s'insinuent dans les modèles d'IA ne sont pas toujours le fruit de mauvaises intentions. Parfois, les données historiques reflètent des inégalités passées. D'autres fois, les méthodes de collecte de données peuvent introduire un biais. Prenons l'exemple d'une IA conçue pour fournir des conseils médicaux. Si elle est entraînée principalement sur des données rédigées par des hommes, elle risque de ne pas saisir certaines subtilités de la santé des femmes.

Les conséquences de données d'entraînement biaisées sont considérables et touchent une multitude de situations, de l'octroi de prêts aux recommandations d'emploi. Prenons l'exemple du recrutement. Une entreprise utilise un assistant de programmation IA pour faciliter son processus d'embauche. Le modèle est entraîné sur des données d'embauche antérieures. Si ces données indiquent que les recrues les plus performantes étaient des hommes possédant une formation spécifique, l'assistant pourrait privilégier les CV de candidats similaires. Ce scénario illustre clairement comment certains candidats peuvent être disqualifiés en raison de leur sexe ou de leur niveau d'études.

Des données d'entraînement biaisées peuvent :

- Perpétuer les inégalités existantes : Les systèmes d'approbation de prêts entraînés sur des données historiques favorisant certaines catégories démographiques pourraient perpétuer ce biais dans leurs réponses automatisées.

- Discriminer certains groupes : Le système de recommandation par IA d'un site de vêtements peut être entraîné sur des données fortement biaisées en faveur d'un profil de taille spécifique lors des achats précédents. Cela pourrait rendre difficile pour les personnes ne correspondant pas à ce profil démographique de trouver des vêtements à leur taille.

- Fournir des résultats inexacts : Une application météo entraînée sur des données provenant d'une région spécifique pourrait avoir du mal à prédire les conditions météorologiques dans d'autres endroits.

« Je suis en train de construire une machine qui n'est pas faite pour moi, il doit y avoir une raison que je ne vois pas. »

Les assistants de programmation IA apprennent en analysant les modèles des données d'entraînement, un peu comme on apprend une nouvelle langue. Si vous avez appris le français en lisant Victor Hugo, vous aurez sans doute du mal à commander en français dans un café parisien. De même, les biais dans les données d'entraînement conduisent l'assistant IA à développer des modèles biaisés dans le code généré.

Cela peut se manifester de plusieurs manières :

- Conventions de dénomination biaisées : Si les données d'entraînement sont axées sur les pronoms masculins lorsqu'il s'agit de désigner les développeurs, le système pourrait alors être calibré pour générer des variables de code à prédominance masculine et exclure involontairement les développeuses.

- Algorithmes inefficaces : Des données d'entraînement conçues pour résoudre des problèmes spécifiques à certains groupes d'utilisateurs peuvent avoir du mal à générer des tâches efficaces en dehors de ce cadre. Un générateur de code IA entraîné à générer du code web pourrait ne pas produire le meilleur code pour appareils mobiles.

Ces biais semblent mineurs, mais leurs conséquences peuvent être désastreuses. La discrimination algorithmique risque de perpétuer les stéréotypes et de renforcer les injustices dans la prise de décision automatisée. De plus, un code biaisé peut engendrer des failles de sécurité. Les assistants IA entraînés sur un réseau fermé pourraient présenter des vulnérabilités exploitables s'ils étaient transférés vers un environnement plus ouvert.

« Tu verras la lumière dans les ténèbres / Tu comprendras quelque chose à cela »

Les biais dans les données d'entraînement peuvent devenir le « fantôme dans la machine » des assistants de programmation IA. Cependant, en appliquant des pratiques de base, nous pouvons garantir que les outils d'IA servent le bien commun.

- Constituez un ensemble d'entraînement diversifié : Tout comme une alimentation saine requiert des aliments variés, les assistants de programmation IA ont besoin de données d'entraînement diversifiées. Les équipes doivent activement rechercher des données provenant de sources et de profils variés. Il est essentiel d'inclure du code écrit par des programmeurs de tous genres, ethnies et milieux. Plus les données d'entraînement sont diversifiées, moins le risque de biais dans le code final est élevé.

- Surveillance humaine : Bien que les assistants de programmation IA performants ne doivent pas fonctionner de manière isolée, une supervision humaine est indispensable pour vérifier le code généré et détecter d'éventuels biais. Leur fonctionnement est comparable à celui d'un éditeur de code capable de distinguer ce qui est équitable de ce qui ne l'est pas. L'intervention humaine permet d'identifier et de corriger les biais avant le déploiement du code.

- Correction des biais de l'algorithme : À mesure que la recherche en IA évolue, les scientifiques développent des techniques pour créer algorithmes débiaisésCes algorithmes sont conçus pour être plus robustes et moins sensibles aux biais des données d'entraînement. Ils offriront une base neutre permettant aux assistants de programmation IA d'apprendre.

Grâce à ces stratégies, nous pouvons faire en sorte que les assistants de programmation IA deviennent de puissants outils de progrès et non des instruments de partialité.

« Nous sommes des esprits dans le monde matériel »

L'influence de la technologie, explorée dans des albums comme Ghost in the Machine de The Police, est plus pertinente que jamais. Les biais présents dans les données d'entraînement empêchent les assistants de programmation IA de tenir leur promesse de révolutionner le développement logiciel. Ce facteur caché agit comme un « soleil invisible » influençant des forces imperceptibles. Ces biais peuvent s'insinuer dans le code généré et entraîner des conséquences imprévues.

L'avenir de l'IA n'est pas figé. L'intégration de jeux de données d'entraînement diversifiés dans les assistants de programmation, la supervision humaine et la recherche sur des algorithmes non biaisés contribueront à atténuer les biais. Pour imaginer un monde où les assistants de programmation sont des remparts d'équité et non des instruments de préjugés, il est essentiel que le développement de l'IA soit guidé par des principes éthiques et un engagement en faveur de l'inclusion. Le potentiel est immense et, en corrigeant les biais inhérents aux machines, nous ferons en sorte qu'elles soient de puissants outils de progrès et non des vecteurs de discrimination.

Vous aimerez aussi

Tests d'applications de santé : pourquoi les défaillances échappent-elles à la détection ?

Pourquoi les défaillances critiques des applications de santé échappent souvent aux tests ? Imaginez ceci : …

Tests en environnement isolé sans compromis : sécurisés et évolutifs

Sécurité ne rime pas avec lenteur : moderniser les tests d’applications dans des environnements isolés…

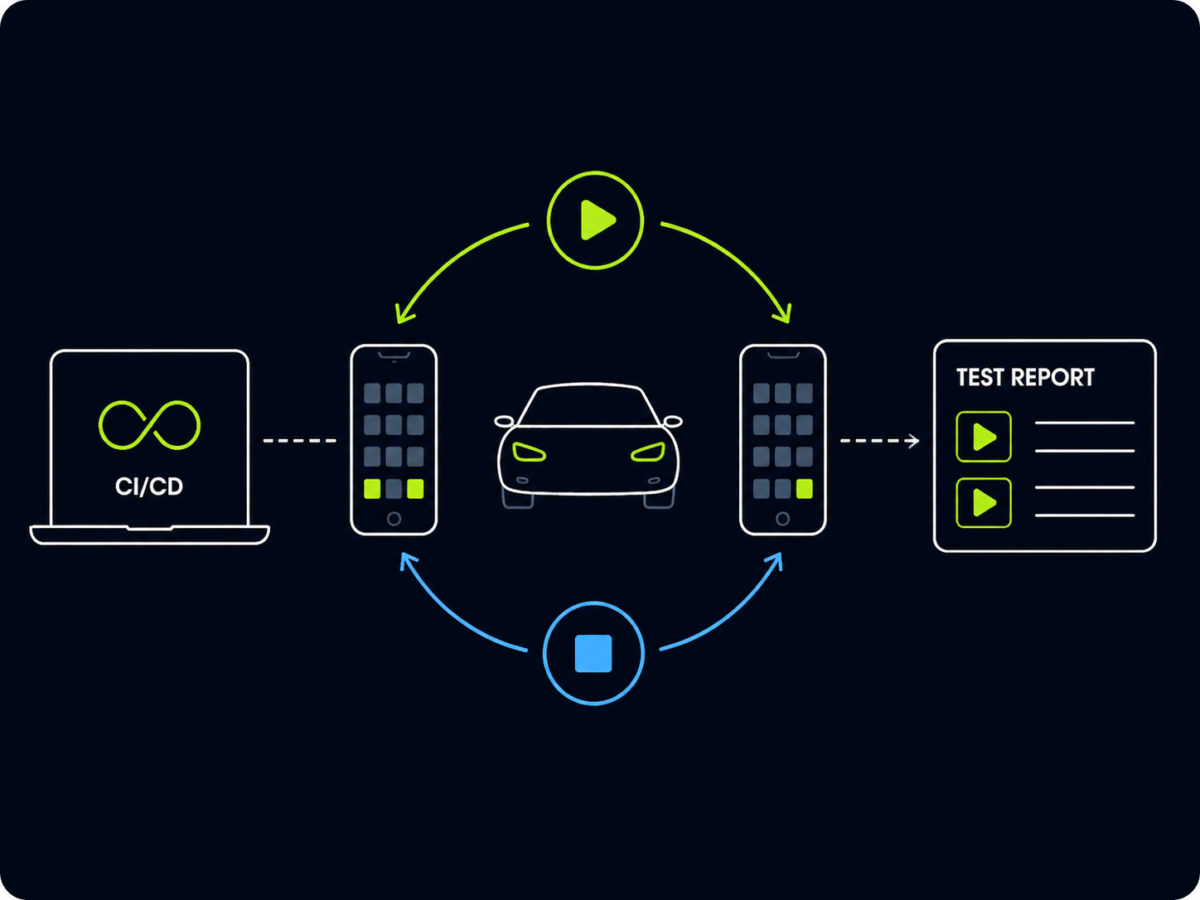

Comment démarrer et arrêter la projection automobile dans les tests Appium

Contrôlez le moment où votre test entre et sort du mode automobile —…