Publicado: Abril 22, 2024

El sesgo en la máquina: Sesgos en los datos de entrenamiento y su impacto en el código generado por los asistentes de IA

1981 fue un año clave para la música inspirada en la informática y el futurismo. Desde la distópica "Red Barchetta" del álbum de Rush Imágenes en movimiento, a la totalidad de Kraftwerk Computer WorldLos artistas miraban hacia el futuro con precisión tecnológica. Como dijo Kraftwerk: «Programo mi ordenador personal y me teletransporto al futuro». Otro álbum de este tipo es Ghost in the Machine de The Police, que utiliza la creciente influencia de la tecnología como tema central. Adoptaron una perspectiva más cínica sobre los posibles inconvenientes del avance tecnológico. El álbum sigue vigente, ya que su visión de un mundo en constante cambio sigue siendo válida.

Desde 1981 y la revolución de la informática doméstica, hemos visto cómo la tecnología se desarrolla a velocidades vertiginosas, culminando (hasta ahora) en el auge de los asistentes de programación con IA. Estas herramientas prometen agilizar el proceso de programación, pero, al igual que el álbum de The Police mencionado anteriormente, que transmite una sensación de alienación subyacente, también hay un factor oculto en juego.

Sesgos en IA

Por muy negativos que sean, los sesgos generan desilusión y se infiltran en los datos de entrenamiento de los asistentes de IA. En la canción «Invisible Sun», The Police habla de la influencia positiva de una fuerza invisible; sin embargo, lo negativo también es cierto. Las herramientas de IA sesgadas pueden tener consecuencias imprevistas y socavar su eficacia. Analicemos, pues, cómo estos sesgos pueden convertirse en los «fantasmas en la máquina» de las herramientas de IA.

“Tengo demasiada información en la cabeza”

El aprendizaje automático impulsa los asistentes de programación con IA y las herramientas generativas, revolucionando la forma en que se desarrolla el software. Su función principal en la programación es gestionar tareas repetitivas y proponer cambios de código de forma fluida. Se les considera al nivel de un desarrollador junior y necesitan una gran cantidad de datos para mejorar. Esto se logra mediante una extensa colección de proyectos anteriores para un asistente de programación con IA. La IA utiliza estos datos como una especie de manual de instrucciones. Con esta información, la IA entrena a su asistente y, al analizar el código, puede comprender patrones y escribir código de forma más eficiente.

La clave reside en la alta calidad y variedad de los datos. Esta información constituye la base del conocimiento de la IA y debe ser lo suficientemente buena como para garantizar resultados de calidad.

“Subyugan a los mansos, pero es la retórica del fracaso”

El talón de Aquiles de los asistentes de código de IA reside en los sesgos ocultos que llevan dentro. Su base son los datos con los que se entrenan los modelos de IA. Al igual que una base descentrada genera grietas y conduce a una estructura inestable, lo mismo ocurre con los modelos de IA. Los datos plagados de sesgos ocultos comprometen todo el modelo de IA. Los sesgos pueden adoptar diversas formas:

- Prejuicios sociales – pueden reflejar prejuicios sociales

- Prejuicios de género – podría favorecer a un género sobre otro

- prejuicios culturales – podría sesgar los datos a favor de culturas específicas.

Las razones por las que los sesgos se introducen en los modelos de IA podrían no ser malintencionadas. A veces, los datos históricos reflejan desigualdades del pasado. Otras veces, los métodos de recopilación de datos pueden introducir un sesgo. Un ejemplo sencillo sería una IA diseñada para brindar asesoramiento médico. Si se entrena principalmente con datos aportados por hombres, podría no captar ciertos matices de la salud femenina.

Las consecuencias de los datos de entrenamiento sesgados son de gran alcance e impactan en un número casi infinito de escenarios, desde la aprobación de préstamos hasta las recomendaciones laborales. Consideremos el ejemplo de la contratación. Una empresa utiliza un asistente de programación con IA para optimizar su proceso de selección. El modelo se entrena con datos de contrataciones anteriores. Si los datos indican que los candidatos más exitosos fueron hombres con una formación académica específica, el modelo podría favorecer los currículos similares a los de esos candidatos. Este escenario ofrece un ejemplo sencillo y evidente de cómo ciertos candidatos podrían ser descartados por su género o nivel educativo.

Los datos de entrenamiento sesgados pueden:

- Perpetuar las desigualdades existentes: Los sistemas de aprobación de préstamos entrenados con datos históricos que favorecían a ciertos grupos demográficos podrían perpetuar ese sesgo en sus respuestas automatizadas.

- Discriminar contra ciertos grupos: El sistema de recomendaciones de IA de una tienda de ropa podría entrenarse con datos de compras anteriores que se centran en un perfil de talla específico. Esto podría dificultar que las personas que no pertenecen a ese grupo demográfico encuentren ropa que les quede bien.

- Proporcionar resultados inexactos: Una aplicación meteorológica entrenada con datos de una región específica podría tener dificultades para predecir los patrones climáticos en otros lugares.

“Estoy construyendo una máquina que no es para mí, debe haber una razón que no puedo ver”.

Los asistentes de código de IA aprenden analizando patrones en los datos de entrenamiento, de forma similar a como aprenden un nuevo idioma. Si aprendieras francés leyendo a Victor Hugo, probablemente te costaría pedir en francés en un café parisino. Del mismo modo, los sesgos en los datos de entrenamiento llevan al asistente de IA a desarrollar patrones sesgados en el código generado.

Esto puede desarrollarse de varias maneras:

- Convenciones de nomenclatura sesgadas: Si los datos de entrenamiento se centran en pronombres masculinos al referirse a los desarrolladores, el sistema podría calibrarse para generar variables de código dominadas por hombres y excluir involuntariamente a las desarrolladoras.

- Algoritmos ineficientes: Los datos de entrenamiento centrados en resolver problemas para perfiles de usuarios específicos podrían tener dificultades para generar tareas eficientes fuera de ese ámbito. Un generador de código de IA entrenado para generar código web podría no generar el mejor código para dispositivos móviles.

Estos sesgos parecen menores, pero las consecuencias pueden ser nefastas. La discriminación algorítmica podría perpetuar estereotipos y reforzar el trato injusto en la toma de decisiones automatizada. Además, el código sesgado puede generar riesgos de seguridad. Los asistentes de IA entrenados con código de red cerrado podrían presentar vulnerabilidades explotables si se migran a un entorno de código abierto.

“Verás la luz en la oscuridad / Encontrarás algún sentido a esto”

Los sesgos en los datos de entrenamiento pueden convertirse en el "fantasma en la máquina" de los asistentes de código de IA. Sin embargo, mediante la implementación de prácticas básicas, podemos garantizar que las herramientas de IA sirvan al bien común.

- Crea un conjunto de entrenamiento diverso: Así como una dieta saludable requiere una variedad de alimentos, los asistentes de código de IA necesitan datos de entrenamiento diversos. Los equipos deben buscar activamente datos de una amplia gama de fuentes y grupos demográficos. Se debe incluir código escrito por programadores de todos los géneros, etnias y procedencias. Cuanto más diversos sean los datos de entrenamiento, menor será la probabilidad de que se introduzca un sesgo en el código final.

- Supervisión humana: Aunque los asistentes de código de IA, potentes y capaces, no deben operar de forma aislada, es necesaria la supervisión humana para revisar el código generado y detectar posibles sesgos. Funcionan de forma similar a un editor de código que, además, puede determinar qué es justo y qué no. La intervención humana permite identificar y corregir los sesgos antes de la implementación del código.

- Eliminación del sesgo del algoritmo: A medida que evoluciona la investigación en IA, los científicos están desarrollando técnicas para crear algoritmos sin sesgoEstos algoritmos están diseñados para ser más robustos y menos susceptibles a datos de entrenamiento sesgados. Ofrecerán una base neutral a partir de la cual los asistentes de código de IA podrán aprender.

Con estas estrategias, podemos asegurar que los asistentes de código de IA se conviertan en poderosas herramientas para el progreso y no en instrumentos de sesgo.

“Somos espíritus en el mundo material”

La influencia de la tecnología, explorada en álbumes como Ghost in the Machine de The Police, es más relevante que nunca. Los sesgos en los datos de entrenamiento impiden que los asistentes de programación de IA cumplan su promesa de revolucionar el desarrollo de software. Este factor oculto es como un «sol invisible» que influye en fuerzas imperceptibles. Los sesgos pueden infiltrarse en el código generado y provocar consecuencias imprevistas.

El futuro no está predeterminado. Integrar conjuntos de entrenamiento diversos en los asistentes de programación de IA, la supervisión humana y la investigación de algoritmos imparciales contribuirá a mitigar los sesgos. Imaginar un mundo donde los asistentes de programación de IA sean pilares de equidad, y no instrumentos de prejuicio, exige que garanticemos que los principios éticos y el compromiso con la inclusión guíen el desarrollo de la IA. Existe un enorme potencial, y al abordar los sesgos inherentes a la máquina, aseguraremos que se conviertan en herramientas poderosas para el progreso y no en perpetuadoras de la discriminación.

También puede interesarle

Pruebas de aplicaciones sanitarias: ¿Por qué se escapan los fallos a la detección?

¿Por qué los fallos críticos en las aplicaciones sanitarias a menudo escapan a las pruebas? Imagínese esto: …

Pruebas aisladas sin compromisos: seguras y escalables.

Seguridad no significa lentitud: modernización de las pruebas de aplicaciones en entornos aislados de la red…

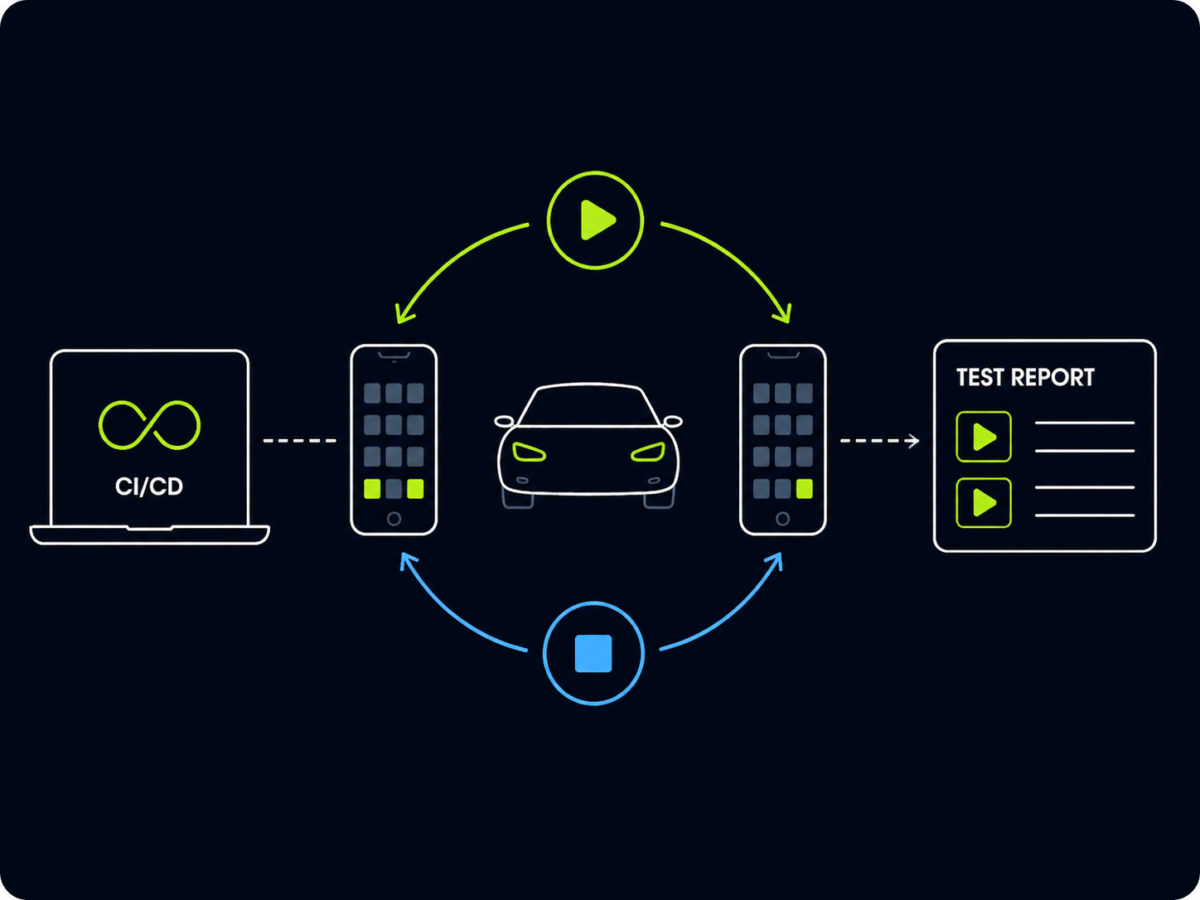

Cómo iniciar y detener la proyección automotriz en las pruebas de Appium

Controla cuándo tu prueba entra y sale del modo automotriz...